AI kommer skremmende nærmere Data fra Star Trek: TNG nå som den vet om du kan stole på den eller ikke

>Det er kanskje ikke så selvbevisst som Data fra Star Trek: TNG (ennå), spesielt siden den droid kunne ta bedre vare på en katt enn noen mennesker, men AI har nå nådd poenget med å innse at den ikke er troverdig.

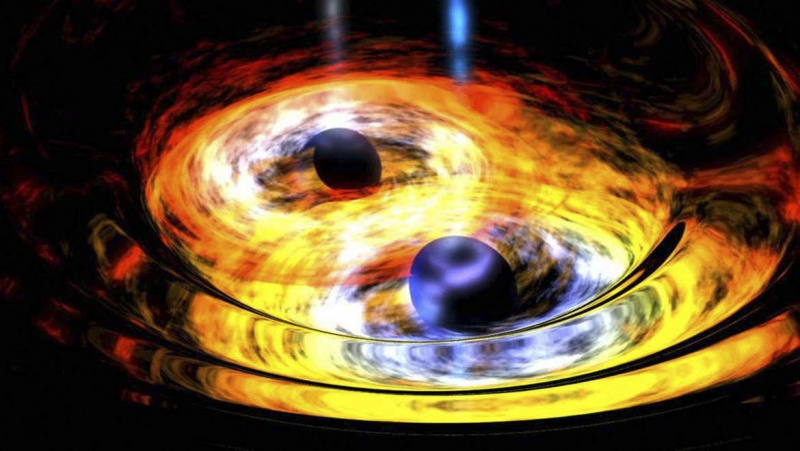

Hva kalles nå dyp bevisst regresjon har jevnet opp selvbevisstheten til AI. Den vil vite når den har en større sjanse for å gjøre en feil i prediksjonen, basert på å evaluere påliteligheten til dataene den ser på. Fremtidige spådommer vil mer sannsynlig fungere hvis de påvirkes av mer grundige og nøyaktige data. Det motsatte betyr at ting sannsynligvis vil gå galt - og AI kan føle det. Når den anslår sin sikkerhet om noe, vil den vissheten gå opp og ned avhengig av dataene den mates med. AI kan deretter bestemme risiko eller usikkerhet med 99% nøyaktighet.

hva er dragon ball z vurdert

Det ser ut til at selv Picard ville bli imponert - men vent. Det er bare en ulempe med selvbevisste roboter, og det er at 99% ikke er full sikkerhet, uansett hvor nært det er. Å være av med bare 1% kan bety katastrofe i potensielt livstruende scenarier, fra å kjøre en autonom bil til å utføre kirurgi. Skummelt.

Selv om [dyp beviselig regresjon] gir flere fordeler i forhold til eksisterende tilnærminger, er dens primære begrensninger å justere regulariseringskoeffisienten og effektivt fjerne ikke-villedende bevis ved kalibrering av usikkerheten, sa MIT Ph.D. student Alexander Amini , som ledet en studie som han vil presentere på neste måneds NeurIPS -konferanse.

Det Amini og teamet hans har klart å gjøre er fortsatt ganske bemerkelsesverdig. Før dette var det ikke bare dyrt å bruke AI til å estimere usikkerhet, men altfor treg for beslutninger som må tas i brøkdeler av et sekund. Nevrale nettverk kan være så enorme at det kan ta evigheter for dem å beregne et svar, og ventetiden med å lære selvtillitsnivået ville være for lang til å engang bry seg om å gjøre en innsats. Det ville være meningsløst å bruke noe slikt i seg selv -kjørende bil som trenger å vite hvilken sving som skal tas med en gang. Prosessen har blitt spolet fremover ved dyp bevislig regresjon. Dette nevrale nettverket trenger bare å kjøre en gang for å finne ut usikkerhetsnivået.

Ved å gjette på usikkerheten i en modell AI allerede har lært, kan den fortelle oss omtrent hvor stor feilmarginen er. AI bruker bevis for å sikkerhetskopiere estimatet. Dette beviset inkluderer enhver usikkerhet som enten lurer i dataene som nettopp er analysert av det neurale nettverket, eller dets selvbevissthet om hvor trygg den er i sin egen beslutning. Amini og teamet hans testet den dype bevismessige regresjonsmetoden ved å trene AI for å estimere dybden på hver piksel i et bilde. Dybdeoppfatning kan bety liv eller død ved en operasjon som må fjerne en svulst som kan være plassert dypt inne i kroppen og vanskelig å se annet.

AI var stort sett nøyaktig, men det rotet opp en gang ble det matet bilder som var vanskeligere å huske. Det var i det minste en ting det var konsistent om: Når det ble stilt overfor bilder som gjorde det vanskelig, ville det uten tvil informere teamet om usikkerheten. Den bestemte marginen for feil kan i det minste lære forskere hvordan de kan forbedre den modellen. Dens evne til å gjenkjenne bilder som hadde blitt photoshoppet, åpner også muligheten for å gjenkjenne deepfakes. Mennesker må bare være klar over at denne robothjernen fortsatt er feilbar, og vi kan ikke stole på den mer enn den kan stole på seg selv.

Vi mener videre undersøkelse er berettiget for å finne alternative måter å fjerne ikke-villedende bevis, Sa Amini .

Betydning, AI som kan tenke å bruke dyp bevislig regresjon er ganske pålitelig så lenge utfallet av et feil svar ikke ville være dødelig.